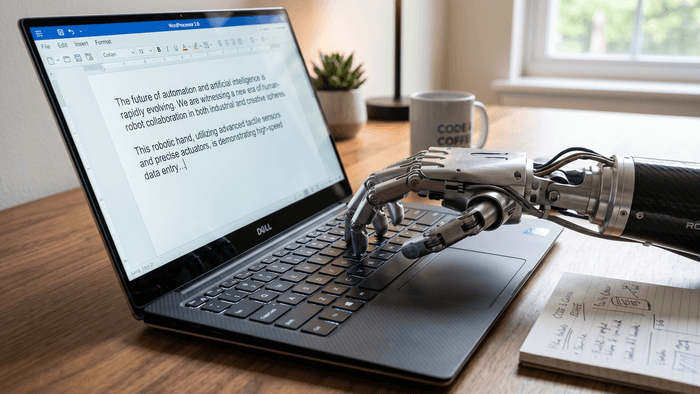

A inteligência artificial deixou de ser uma promessa distante e virou ferramenta de produção em massa. Hoje, ela já está por trás de textos de blog, descrições de produtos e posts em redes sociais, o que acelera a entrega de conteúdo em um nível que simplesmente não existia há poucos anos. O problema é que essa escala trouxe uma pergunta inevitável: dá para confiar em tudo o que está sendo publicado na web hoje?

O crescimento do conteúdo gerado por IA é evidente. Empresas produzem mais; criadores publicam com mais frequência; portais escalam operação sem necessariamente expandir equipe. Só que esse ganho de eficiência tem um custo direto: a percepção de qualidade e autenticidade começa a entrar em xeque.

Quando qualquer texto pode ser gerado em segundos, distinguir o que tem intervenção humana real do que é apenas reorganização de dados vira um desafio.

-

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

-

O impacto da IA na produção de conteúdo digital

Do ponto de vista operacional, a IA resolveu vários gargalos. Produção mais rápida; estruturação de ideias quase instantânea; menos dependência de equipes grandes. Isso explica por que a adoção disparou.

Mas o efeito colateral também já aparece com clareza:

- Conteúdos genéricos e superficiais;

- Repetição de informações já existentes;

- Falta de experiência prática ou análise crítica;

- Risco maior de erro factual ou desatualização.

É notável que o volume cresceu mais rápido que a qualidade. E para quem trabalha com tecnologia, mídia ou marketing, isso atinge diretamente seu principal ativo, que é indiscutivelmente a credibilidade.

Autenticidade virou métrica

Em 2026, autenticidade digital deixou de ser conceito abstrato e virou critério de avaliação. Espera-se que cada vez mais um texto entregue valor real, enquanto a possibilidade de aquilo ter sido escrito por uma IA não necessariamente entra na conta.

Leitores estão mais atentos; plataformas de busca estão mais exigentes; empresas estão mais cautelosas. Conteúdo automatizado em massa, sem curadoria, tende a perder relevância com o tempo, especialmente em SEO.

Ou seja: validar origem e qualidade deixou de ser etapa opcional.

Dá para identificar conteúdo gerado por IA?

Ainda existem alguns padrões relativamente comuns:

- Estrutura previsível demais;

- Linguagem correta, mas sem identidade;

- Falta de exemplos concretos;

- Pouca profundidade em temas mais complexos;

- Repetição de ideias com pequenas variações.

Nada disso é prova definitiva, mas funciona como indício. O problema é que esses sinais estão ficando cada vez mais sutis à medida que os modelos evoluem.

Ferramentas entram como camada de verificação

Com esse cenário, surgiram soluções focadas em análise de conteúdo. Ferramentas de verificação de IA tentam identificar padrões de escrita automatizada e ajudam a filtrar o que pode precisar de revisão. Rawad Baroud, fundador da ZeroGPT, resumiu bem a situação:

“A inteligência artificial não é o problema. O desafio é garantir transparência.”

O que muda na prática

Quem quiser manter relevância vai precisar ajustar o processo. Algumas medidas básicas já fazem diferença:

- Revisar todo conteúdo antes de publicar;

- Inserir contexto e experiência humana;

- Evitar dependência total de automação;

- Usar ferramentas de verificação como apoio;

- Priorizar qualidade em vez de volume.

Pode parecer que a sugestão aqui seja produzir menos, mas, na verdade, a ideia é produzir melhor.

A tendência mais clara é a convivência. IA continua sendo usada para acelerar produção, organizar ideias e ganhar eficiência. Mas o diferencial competitivo passa a ser humano: análise, contexto e originalidade. Conteúdo relevante não é só informação organizada, é interpretação.

Leia a matéria no Canaltech.